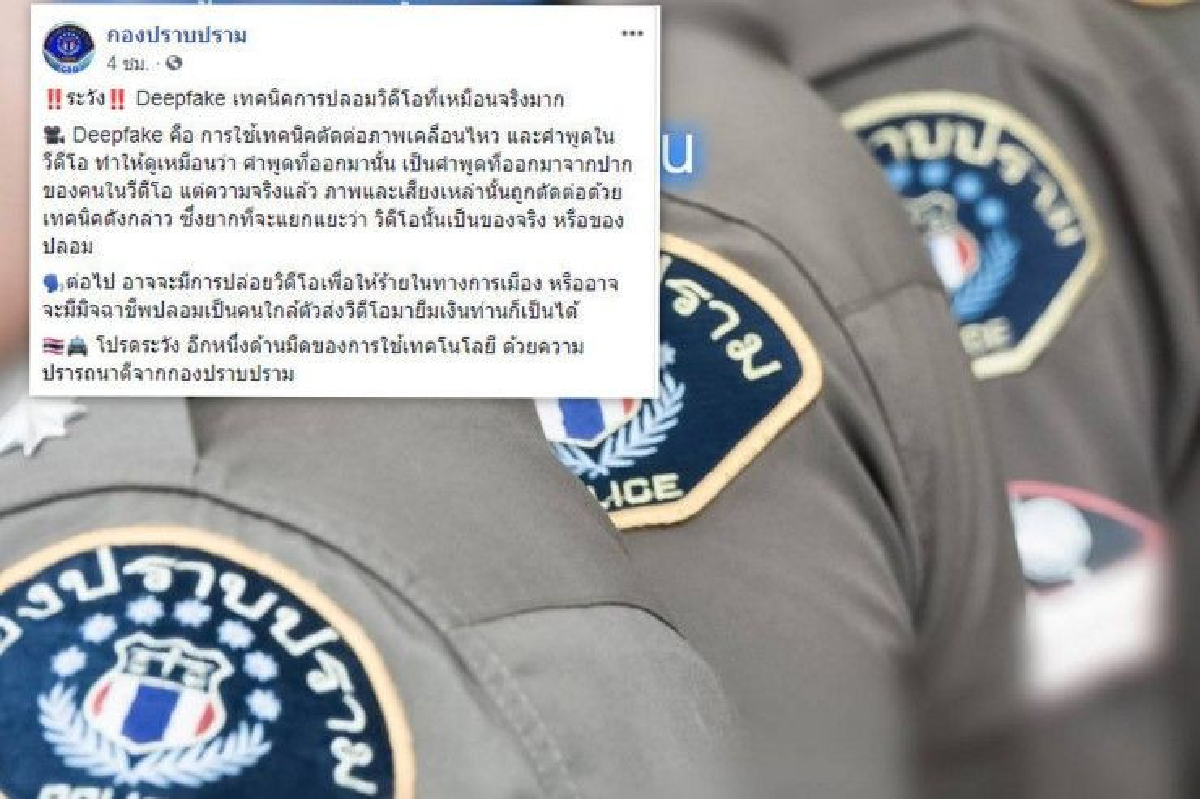

กองปราบเตือนระวัง "Deepfake" ที่อาจนำมาใช้ใส่ร้ายในเกมการเมือง

กองปราบปรามเตือนระวังเทคนิคปลอมวิดีโอ Deepfake ที่ใช้ใส่ร้ายทางการเมืองหรือมิจฉาชีพปลอมมายืมเงิน

กองปราบปรามเตือนระวังเทคนิคปลอมวิดีโอ Deepfake ที่ใช้ใส่ร้ายทางการเมืองหรือมิจฉาชีพปลอมมายืมเงิน

เมื่อวันที่ 3 ก.พ. เพจเฟซบุ๊ก “กองปราบปราม” ของกองบังคับการปราบปราม โพสต์เฟซบุ๊กแจ้งเตือนประชาชนให้ระวังและอย่าหลงเชื่อเทคนิคการปลอมวิดีโอ Deepfake ซึ่งมีความเหมือนจริงมาก เพราะต่อไปอาจมีการปล่อยวิดีโอเพื่อให้ร้ายในทางการเมือง หรืออาจมีมิจฉาชีพปลอมเป็นคนใกล้ตัวส่งวิดีโอมายืมเงินก็เป็นได้

สำหรับ Deepfake คือ เทคโนโลยีภูมิปัญญาประดิษฐ์ หรือ เอไอ ที่เดิมทีถูกสร้างขึ้นเพื่อเลียนแบบความคิดมนุษย์ และกำลังถูกพัฒนาให้สามารถเลียนแบบพฤติกรรมน้ำเสียงและท่วงทำนองการพูด โดยใช้เทคนิคตัดต่อภาพเคลื่อนไหวและคำพูดในวีดีโอซึ่งทำให้ดูเหมือนว่า คำพูดที่ออกมาเป็นคำพูดที่มาจากปากของคนในวีดีโอ แต่ความจริงแล้วภาพและเสียงเหล่านั้นถูกตัดต่อด้วยเทคนิคดังกล่าวซึ่งยากที่จะแยกแยะว่าวิดีโอนั้นเป็นของจริงหรือไม่

ที่ผ่านมาเคยมีคนดังและผู้ประเทศตกเป็นเหยื่อจากเทคโนโลยีดังกล่าว อาทิ โดนัลด์ ทรัมป์ ผู้นำสหรัฐ , บารัค โอบามา อดีตผู้นำสหรัฐ , เอ็มมา วัตสัน นักแสดงฮอลลีวู้ด จนทำให้สร้างความเสื่อมเสียมาแล้ว